ChatGPT peut désormais voir, entendre et parler

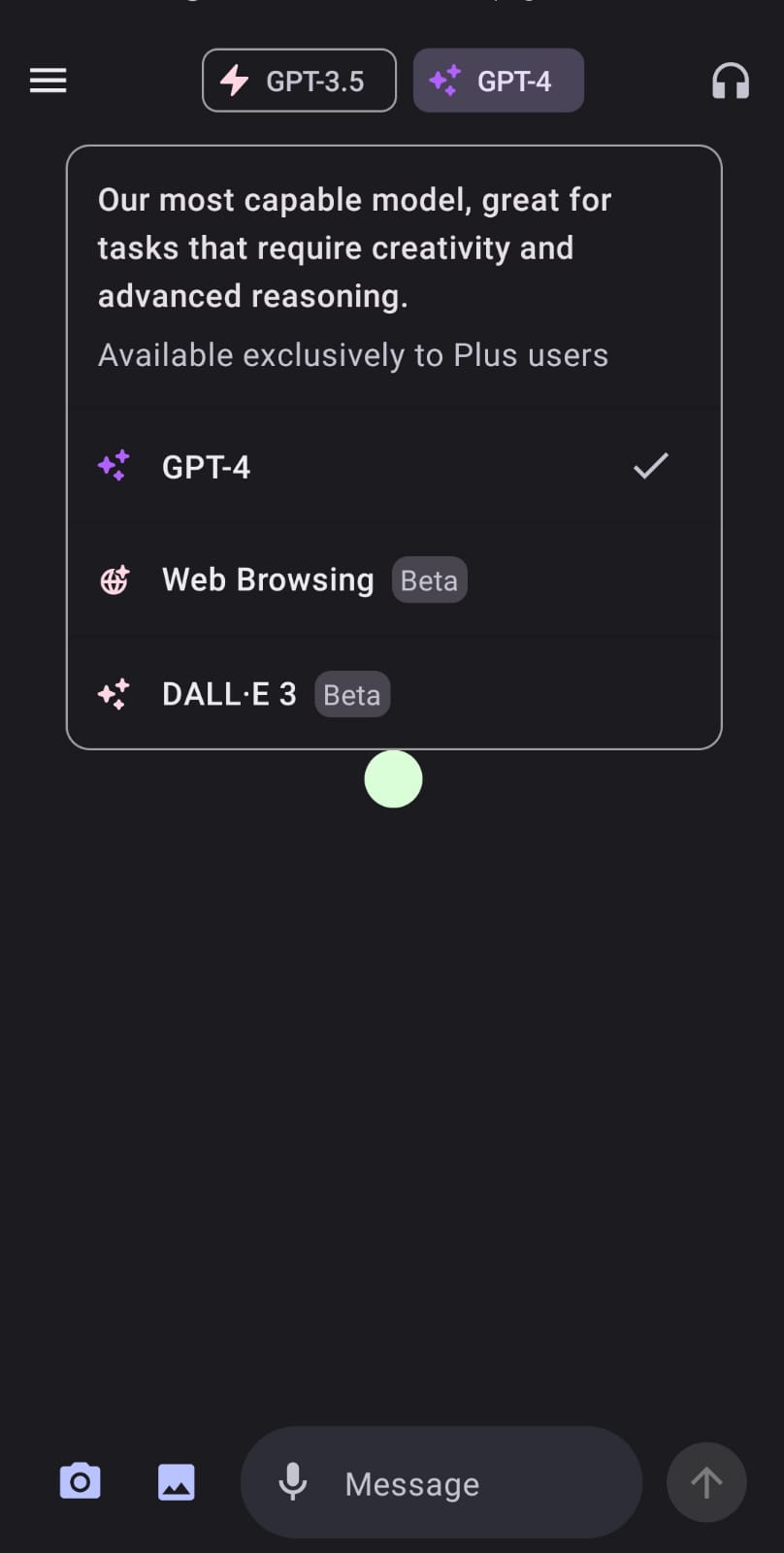

C’est exact. ChatGPT, le chatbot conversationnel développé par OpenAI, a été mis à jour le 27 septembre 2023 pour lui permettre de voir, entendre et parler. Cette mise à jour est rendue possible par les modèles GPT-3.5 et GPT-4 multimodaux, qui appliquent leur raisonnement linguistique à un large éventail d’images, y compris des photographies, des captures d’écran et des documents mixtes texte-image.

Avec cette nouvelle capacité, ChatGPT peut désormais converser avec l’utilisateur à l’aide de l’image, de la caméra et de la voix. Il peut par exemple répondre à des questions sur des images, traduire des langues en temps réel ou même générer des dialogues.

Voici quelques exemples de ce que ChatGPT peut faire avec sa nouvelle capacité :

- Voir et comprendre les images

ChatGPT peut désormais voir et comprendre les images. Il peut par exemple répondre à des questions sur le contenu d’une image, identifier des objets ou des personnes ou même générer une description de l’image.

- Entendre et comprendre la voix

ChatGPT peut désormais entendre et comprendre la voix. Il peut par exemple répondre à des questions orales, traduire des langues en temps réel ou même générer des dialogues.

- Parler

ChatGPT peut désormais parler. Il peut par exemple générer des discours, des narrations ou même des chansons.

Cette nouvelle capacité ouvre de nombreuses possibilités pour ChatGPT. Il pourrait être utilisé pour améliorer la qualité des interactions entre les humains et les machines, pour développer de nouveaux outils éducatifs ou pour créer de nouvelles formes de divertissement.

Voici quelques exemples de la manière dont ChatGPT pourrait être utilisé :

- Assistant virtuel

ChatGPT pourrait être utilisé comme assistant virtuel. Il pourrait par exemple aider les utilisateurs à trouver des informations, à gérer leurs tâches ou même à réserver des rendez-vous.

- Outil éducatif

ChatGPT pourrait être utilisé comme outil éducatif. Il pourrait par exemple aider les étudiants à apprendre de nouvelles langues, à résoudre des problèmes mathématiques ou même à écrire des histoires.

- Forme de divertissement

ChatGPT pourrait être utilisé comme forme de divertissement. Il pourrait par exemple générer des jeux, des histoires ou même des pièces de théâtre.

Il est encore trop tôt pour dire comment ChatGPT sera utilisé dans le futur. Cependant, il est clair que cette nouvelle capacité a le potentiel de révolutionner la manière dont nous interagissons avec les machines.